北京时间 8 月 6 日早间消息,苹果公司周四表示,该公司将向执法部门报告上传到其美国 iCloud 服务上的儿童性虐待图片。

苹果公司的新系统将使用一种名为“哈希”(hashing,把任意长度的输入通过散列算法变换成固定长度的输出)的进程,对所谓的“儿童性虐待材料”(Child Sexual Abuse Material,简称为“CSAM”)图片进行监测,随后将图片转换为与其对应的唯一数字。

苹果公司周四开始测试该系统,但该公司表示,大多数美国 iPhone 用户都要到今年晚些时候 iOS 15 更新后才能使用这个系统。

在苹果公司采取这项举措之前,其他云服务也已采取类似措施,对用户文件进行扫描(通常也都使用“哈希”系统)以发现违反其服务条款的内容,其中包括儿童性虐待图片等。

与此同时,这也是对苹果公司的一次考验。苹果公司表示,与之前消除儿童性虐待非法图片的方法相比,该公司的系统对用户来说更加私密,原因是其在苹果公司的服务器和用户设备上都使用了复杂的密码系统,而且不会对实际图片进行扫描,只会扫描“哈希”。但对许多在隐私问题上反应敏感的用户来说,他们仍然不愿看到自己使用的软件向政府通报设备或云服务中的内容,因此可能会对苹果公司此举做出负面反应 —— 特别是由于苹果公司一直都在发声捍卫设备加密,而且在该公司进行业务运营的国家,言论保护比美国要少。

世界各地的执法官员也已经向苹果公司施压,要求其削弱对 iMessage 和 iCloud 等其他软件服务的加密,以便调查儿童性虐待或恐怖主义等行为。对苹果公司来说,周四此举表明该公司希望找到一种方法,在不放弃一些有关用户隐私的工程原则的情况下,解决其中一些问题。

新系统如何运作

在图片存储到苹果公司的 iCloud 服务之前,该公司会将图片的“哈希”与美国国家失踪与受虐儿童中心(以下简称“NCMEC”)提供的散列数据库进行比对。苹果公司表示,这个数据库将从该公司发布 iOS 15 更新时开始启用,以 iOS 代码的形式发布。匹配过程将在用户的 iPhone 上完成,而不是在云端。

如果苹果公司随后在某个 iCloud 账号中检测到一定数量的违规文件,那么该系统将会上传一个文件,允许苹果公司解密并查看该账号上的图片,随后将由人工查看图片以确认是否匹配。

苹果公司将只能审查与已知内容相匹配的图片,并将其报告给这些数据库。举例来说,该公司将无法检测洗澡儿童的父母的照片,因为这些图片不会进入 NCMEC 数据库。

如果负责人工审查的人员得出结论认为系统没有出错,那么苹果公司将会禁用上传违规图片的用户的 iCloud 账号,并在如有必要时向 NCMEC 发送报告或通知执法部门。苹果公司的一位代表称,如果用户认为自己的账号被错误地标记了,则可向该公司提出上诉。

苹果公司表示,该系统只适用于上传到 iCloud 服务的图片(用户可以选择关闭这个系统),不适用于未上传到该公司服务器的设备上的照片或其他图片。

不会被用于识别其他图片

一些安全研究人员担心,这项技术最终可能会被用来识别其他类型的图片,比如政治抗议的照片等。苹果公司则表示,该公司的系统只适用于 NCMEC 或其他儿童安全组织编目的图片,而且该公司构建密码系统的方式可以防止其被用于其他目的。

苹果公司称,该公司不能向数据库里添加额外的“哈希”。该公司称其正在向密码学专家展示这个系统,以证明它可以在不损害用户隐私的情况下检测非法的儿童性虐待图片。

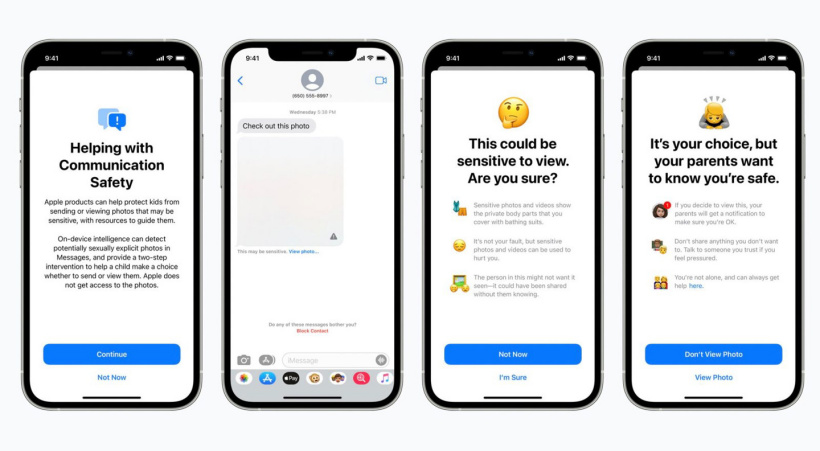

在周四发布这项功能的同时,苹果公司还发布了其他一些旨在保护儿童免受性剥削者攻击的功能。其中一项功能是,苹果公司将在拥有家庭账号的儿童 iPhone 上使用机器学习技术来对可能包含裸体的图片进行模糊处理,而父母可以选择一种警报功能,以便在 13 岁以下的儿童在 iMessage 中收到骚扰内容时收到警报。另外,苹果公司还更新了 Siri,提供了如何举报儿童性虐待内容的信息。

特别提醒:本网信息来自于互联网,目的在于传递更多信息,并不代表本网赞同其观点。其原创性以及文中陈述文字和内容未经本站证实,对本文以及其中全部或者部分内容、文字的真实性、完整性、及时性本站不作任何保证或承诺,并请自行核实相关内容。本站不承担此类作品侵权行为的直接责任及连带责任。如若本网有任何内容侵犯您的权益,请及时联系我们,本站将会在24小时内处理完毕。

站长资讯网

站长资讯网